14 outils webmasters en ligne à ouvrir en un clic

14 outilsCette page est conçue pour l’action : d’abord les outils qui règlent un problème immédiat, puis le classement par besoin pour enchaîner sans se perdre entre valeur de site, snippet, balises, crawl, redirections, indexation, données structurées et tracking.

Valeur d’un site

Obtenir un ordre de grandeur sur la valeur d’un site web pour un benchmark rapide, une reprise de site ou une première estimation avant achat. C’est un bon point d’entrée pour comparer plusieurs sites, cadrer un audit rapide ou obtenir un premier ordre de grandeur avant d’ouvrir les autres contrôles SEO.

Ouvrez un outil phare ci-dessus, puis utilisez ce classement pour continuer avec le bon contrôle : estimation, publication, crawl, redirections, balisage ou suivi.

Choisir par usage, sans tourner en rond

Estimation de site, avant publication, crawl & indexation, contrôles techniques ou tracking : chaque famille renvoie directement vers les bons utilitaires pour garder une navigation simple et rapide.

Les guides servent surtout à comprendre l’ordre des contrôles, les différences entre les signaux et les bons réflexes à garder quand on corrige une page ou un site.

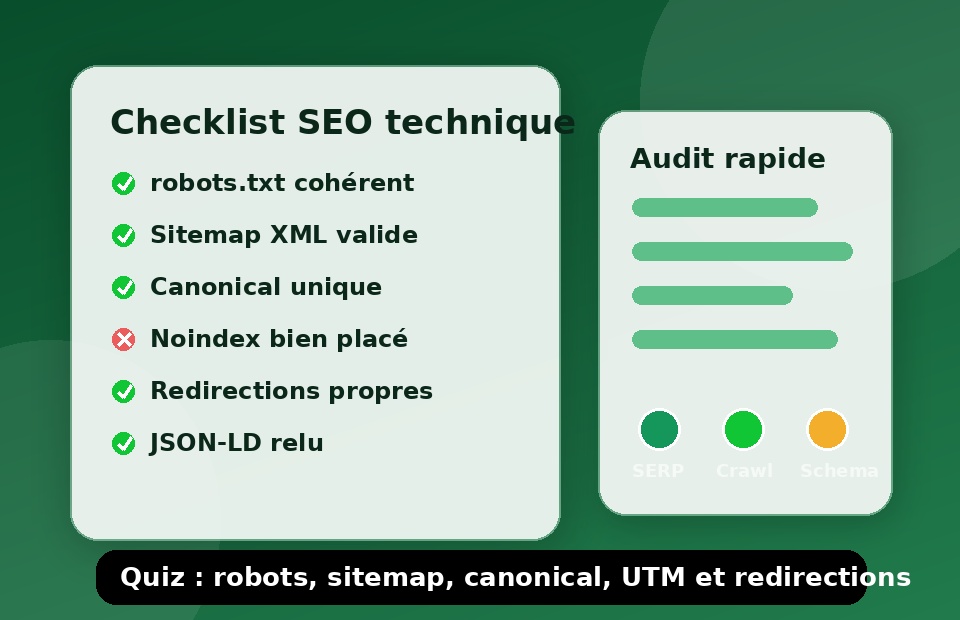

Avez-vous les bons réflexes SEO techniques ?

Quiz

Bien utiliser les outils webmasters

MéthodeLes outils webmasters servent surtout à vérifier un point concret rapidement. Pour un benchmark ou une reprise de site, commencez par la valeur d’un site. Pour une page en préparation, enchaînez en général avec l’aperçu SERP Google, le test des balises puis le slug URL. Ils complètent ensuite les outils de suivi comme Search Console, plutôt que de les remplacer.

Pour un audit technique ou une reprise de site, passez ensuite par robots.txt, sitemap XML, canonical / noindex, redirections, JSON-LD et structure H1 / H2. Chaque outil répond à un besoin précis, il vaut donc mieux les utiliser dans le bon ordre plutôt que tout mélanger en même temps.

Google Search Central pour robots.txt, canonical, noindex et sitemaps, sitemaps.org pour le format XML, Schema.org pour les types de données structurées, MDN pour les redirections HTTP et les codes de statut.

Ne mélangez pas les rôles : robots.txt agit sur le crawl, noindex sur l’indexation, canonical sur la version de référence, redirection sur le déplacement d’URL et le JSON-LD sur la compréhension structurée d’une page.

FAQ : outils webmasters

La rubrique rassemble des outils pour estimer un site, préparer une page, contrôler son indexation, vérifier ses redirections, relire son balisage structuré et gérer des URL de campagne. Le but est d’ouvrir vite l’utilitaire utile, sans détour.

Non. Les outils webmasters de cette rubrique sont pensés pour être utilisés directement dans le navigateur, sans installation lourde.

Non. Ils la complètent. Search Console sert surtout à suivre l’indexation, les impressions, les clics et les alertes. Ici, vous ouvrez plutôt des utilitaires ponctuels pour prévisualiser, générer ou vérifier un point précis.

Le fichier robots.txt sert surtout à donner des consignes de crawl, alors que le sitemap XML sert à signaler des URL utiles à découvrir. Les deux sont complémentaires, mais ils ne jouent pas le même rôle.

La balise canonical sert à désigner une URL de référence lorsqu’un contenu existe sous plusieurs variantes. La consigne noindex sert à demander qu’une page ne soit pas indexée. Ce sont deux signaux différents.

Dans la plupart des cas, commencez par l’aperçu SERP Google, le test meta title / description et le générateur de slug URL. Vous contrôlez ainsi tout de suite le rendu, le texte et l’adresse de la page.

Oui pour un premier contrôle. Vous pouvez vérifier le snippet, l’indexation, les redirections, le JSON-LD et la structure H1 / H2. Pour aller plus loin, la checklist d’audit SEO technique et les guides de la rubrique servent d’appui.